Un abbonamento che cambia il tuo modo di guardare le Serie Tv

Con così tante piattaforme e poco tempo a disposizione, scegliere cosa vedere è diventato complicato. Noi vogliamo aiutarti ad andare a colpo sicuro.

Arriva Hall of Series Discover, il nostro nuovo servizio pensato per chi vuole scoprire le serie perfette i propri gusti, senza perdersi in infinite ricerche. Ogni settimana riceverai direttamente sulla tua email guide e storie che non troverai altrove:

- ✓ Articoli esclusivi su serie nascoste e poco conosciute in Italia

- ✓ Pagelle e guide settimanali sulle serie tv attualmente in onda

- ✓ Classifiche mensili sulle migliori serie tv e i migliori film del mese

- ✓ Consigli di visione personalizzati e curati dalla nostra redazione (e non un altro algoritmo)

- ✓ Zero pubblicità su tutto il sito

Eugenia ha un migliore amico che non è un fidanzato.

Si chiama Roman, e la sua vita si è spenta a seguito di un tragico incidente su fredde strade che non sono quelle inglesi.

È giusto non parlare al passato, perché Roman esiste ancora. O, per meglio dire, un suo surrogato di coscienza esiste ancora.

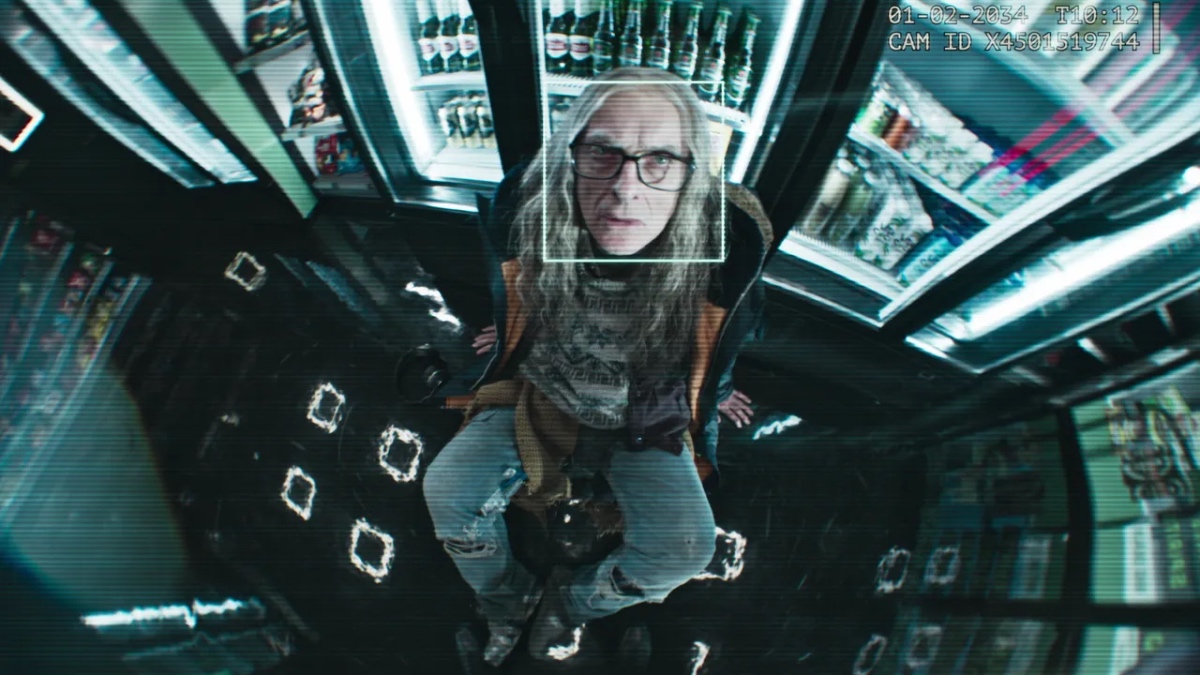

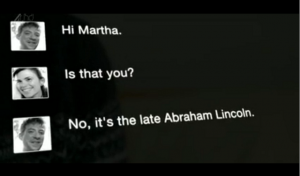

Allo stesso modo è giusto non parlare al passato di Ash, fidanzato di Martha, nell’episodio “Be Right Back” di Black Mirror e vittima di un incidente stradale.

Quello che è lecito ricordare come uno dei migliori episodi della serie andava in onda l’11 Febbraio 2013, e con cauto avvenirismo ha saputo raccontare la caducità della tecnologia al cospetto del dramma umano, l’ossimorico trionfo del fallibilismo.

È forse quest’ultimo il termine più pertinente per descrivere il fine ultimo della retorica in Black Mirror: il fallibilismo, la concezione secondo cui la scienza si limiti a offrire nient’altro che ipotesi interpretative della realtà, tutte indirizzate al superamento.

Questo fa “Be Right Back” quando ci mostra l’escalation dell’insoddisfazione e il senso di fallimento nel tentativo di “risolvere” la morte con la tecnologia. Quella di Martha si rivela una reazione, e in quanto tale è istintiva e approssimativa, solo apparentemente articolata e affidabile.

Il palliativo di Martha, la sua soluzione epidermica, diventa 5 anni dopo oggetto di emulazione nel mondo reale.

Il 28 Novembre 2015, nel centro di Mosca, un uomo di 34 anni di nome Roman Mazurenko è stato investito da un’auto che correva all’impazzata. La sua migliore amica, Eugenia Kuyda, è giunta all’ospedale nel quale l’uomo era stato ricoverato d’urgenza, senza riuscire però a dargli l’ultimo sperato saluto.

Questo è stato il rimorso più grande della donna (co-fondatrice dell’azienda Luka specializzata nello sviluppo di software basati sull’intelligenza artificiale), la quale è rimasta colpita ed espressamente ispirata dall’accuratezza tecnica dell’episodio di Black Mirror, tanto da decidere di sfruttare il machine learning (apprendimento automatico) per sviluppare una chatbot con l’obiettivo di “riportare in vita” il suo migliore amico.

La funzionalità della machine learning è già insita nel quotidiano, in termini di comodità: algoritmi in grado di leggere i dati e trasformarli in azioni (l’esempio più noto può essere il sistema Siri di iPhone).

È così che ha operato Eugenia, trovandosi a scorrere i messaggi di tutte le discussioni che aveva avuto in chat con l’amico defunto e accorgendosi di avere abbastanza dati utili per riprodurre personalità e schema linguistico di Roman.

Per la realizzazione del progetto ci sono volute circa 8.000 righe di testo, raccolte da diverse chat private che amici e parenti hanno autorizzato a sfruttare. Gli stessi amici e parenti sono stati i primi a testare il prodotto finito, riscontrando a loro detta una somiglianza inquietante.

Il successo del lavoro ha portato alla realizzazione di un’app della quale ora Eugenia Kuyda è startupper: Replika, un sistema di raccolta dati, un contenitore che l’utente stesso decide di riempire con info utili alla realizzazione di un bot creato a propria immagine e somiglianza, che si perfeziona automaticamente interagendo e “discutendo” con questo giorno dopo giorno.

La stessa Eugenia Kuyda la definisce ad oggi come nient’altro che “l’ombra di una persona, ma comunque qualcosa che non era possibile solo un anno fa”; un pensiero realistico ma al tempo stesso fiducioso per il futuro.

Ma la domanda che la nostra etica costringe a porci è: che valore ha il rituale della perdita nella nostra concezione dell’esistenza?

La storia di Eugenia e del suo migliore amico Roman non è certo un “banale” e controproducente effetto Werther, non è l’emulazione del “bello” o la devianza del “comodo”.

Quello di Eugenia è il naturale istinto comportamentale dell’uomo, che da animale sociale tende a usare le azioni degli altri (in questo caso, quelle di Martha in Black Mirror) per decidere cosa è appropriato fare, catalogandoli all’occorrenza come simili per condizione sociale (lo stato di lutto e incessante dolore) e identificandosi in essi.

Eppure, sentiamo che stiamo sbagliando qualcosa.

Martha sente che sta sbagliando qualcosa.

Come se memorie fasulle sovrascrivessero momenti autentici di identità irripetibili.

Forse sentiamo, semplicemente, di star sbagliando ricordi.